مع التسارع الكبير في وتيرة التطور التكنولوجي الذي يشهده العالم اليوم، أصبح من الواضح أن التطبيقات والابتكارات الرقمية باتت جزءاً أساسياً من حياتنا اليومية. وقد أخذ الذكاء الاصطناعي مكانه في صدارة هذه التقنيات، بعد أن تمدد بسرعة غير مسبوقة داخل الفضاء الرقمي، حتى يتحول إلى أداة ذات تأثير واسع تُستخدم في مختلف المجالات، بما في ذلك إنتاج محتوى قد يُستغل بشكل غير مسؤول، مثل التأثير على الرأي العام أو تشويه سمعة الخصوم.

وفي هذا السياق، جاءت الانتخابات العراقية التي جرت في 11 تشرين الثاني 2025 لتشكّل محطة لافتة، إذ شهدت لأول مرة توظيف تقنيات الذكاء الاصطناعي بشكل مكثّف في إدارة الحملات الانتخابية وتنسيق الأنشطة الإعلامية عبر المنصات الرقمية، مما أضاف بعداً جديداً للدعاية والتأثير السياسي على المرشح نفسه وعلى الناخبين والشارع العراقي، إذ شهدت منصات التواصل تداولاً متزايداً لمقاطع فيديو مولدة بالذكاء الاصطناعي استُخدمت للتحريض على المرشحين/ات أو للنيل من سمعة بعضهم، الأمر الذي قد يساهم في تصاعد خطاب الكراهية بين المؤيدين والمعارضين لأي شخصية تكون هدفاً لهذه المحتويات.

هجمات تمتد من التشهير بالمرشحات إلى اتهام المرشحين بالعمالة

يوم 4 تشرين الأول 2025، انتشر ادعاء على منصة إكس ادعى ناشره بأنه فيديو إباحي للنائب والمرشحة عالية نصيف، مع رئيس منظمة بدر هادي العامري، ويظهرها وهي ترقص. وما لبث أن حقق انتشاراً واسعاً، فقد حصد الادعاء أكثر من 143 ألف مشاهدة على منشور واحد فقط (حتى لحظة كتابة هذا التقرير). وبدأت بعض الصفحات الأخرى بإعادة نشره وتداوله، ما أسهم في انتشاره أكثر داخل الشارع العراقي.

فضيحة هادي العامري وعالية تصيف فيديو يظهر فيه هادي العامري وعالية نصيف في فلم +18 #عالية_نصيف #هادي_العامري pic.twitter.com/ZIW9KZExvk

— فكر حر (@fekrhur1) October 4, 2025

وبعد التحقق من الادعاء، تبيّن أن المقطع المتداول يعود في الأصل إلى راقصة أوكرانية تُدعى (Tais Nonko)، وقد نشرته عبر حسابها على منصة تيكتوك بتاريخ 28 آب 2023. غير أن الفيديو جرى التلاعب به باستخدام إحدى أدوات المونتاج الاحترافي أو أنه قد جرى تعديله باستخدام أدوات الذكاء الاصطناعي، حيث تم استبدال وجه الراقصة بوجه النائب عالية نصيف إضافة إلى قلب اتجاه المقطع، ليظهر بالشكل المفبرك الذي جرى تداوله.

وقد أسهم تداول هذا المقطع، في تعزيز خطاب الكراهية ضد النائب واستهداف سمعتها الشخصية بعد إعادة نشر ذات المنشور، على الرغم من أن نصيف ردت على هذا الادعاء من خلال صفحتها الرسمية على إكس، والتي وصفتها بأنها “حملة ممنهجة” ضدها وضد شخصيات أخرى، إلا أن الصفحات التي تداولت المنشور لم تتراجع عن نشره أو تحذفه.

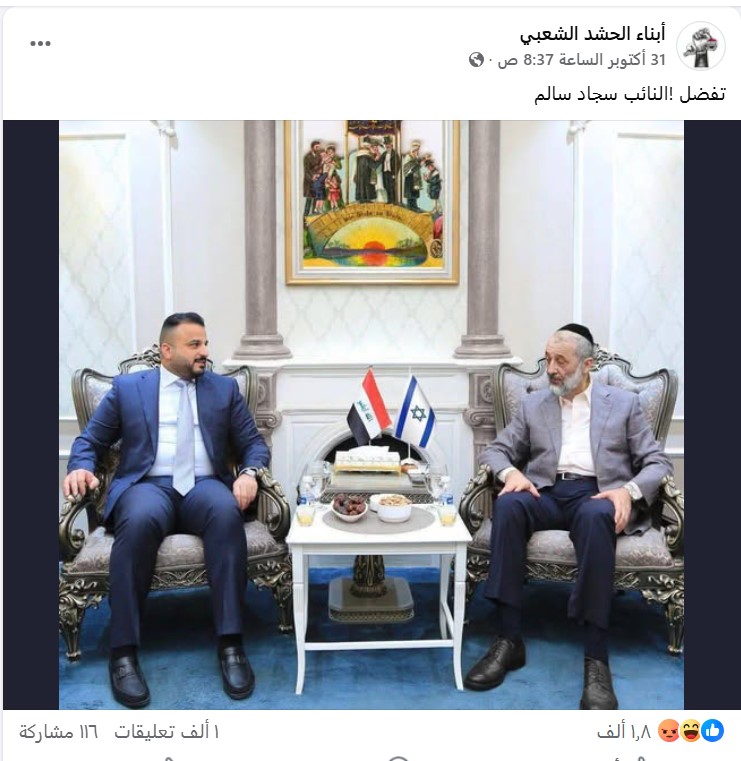

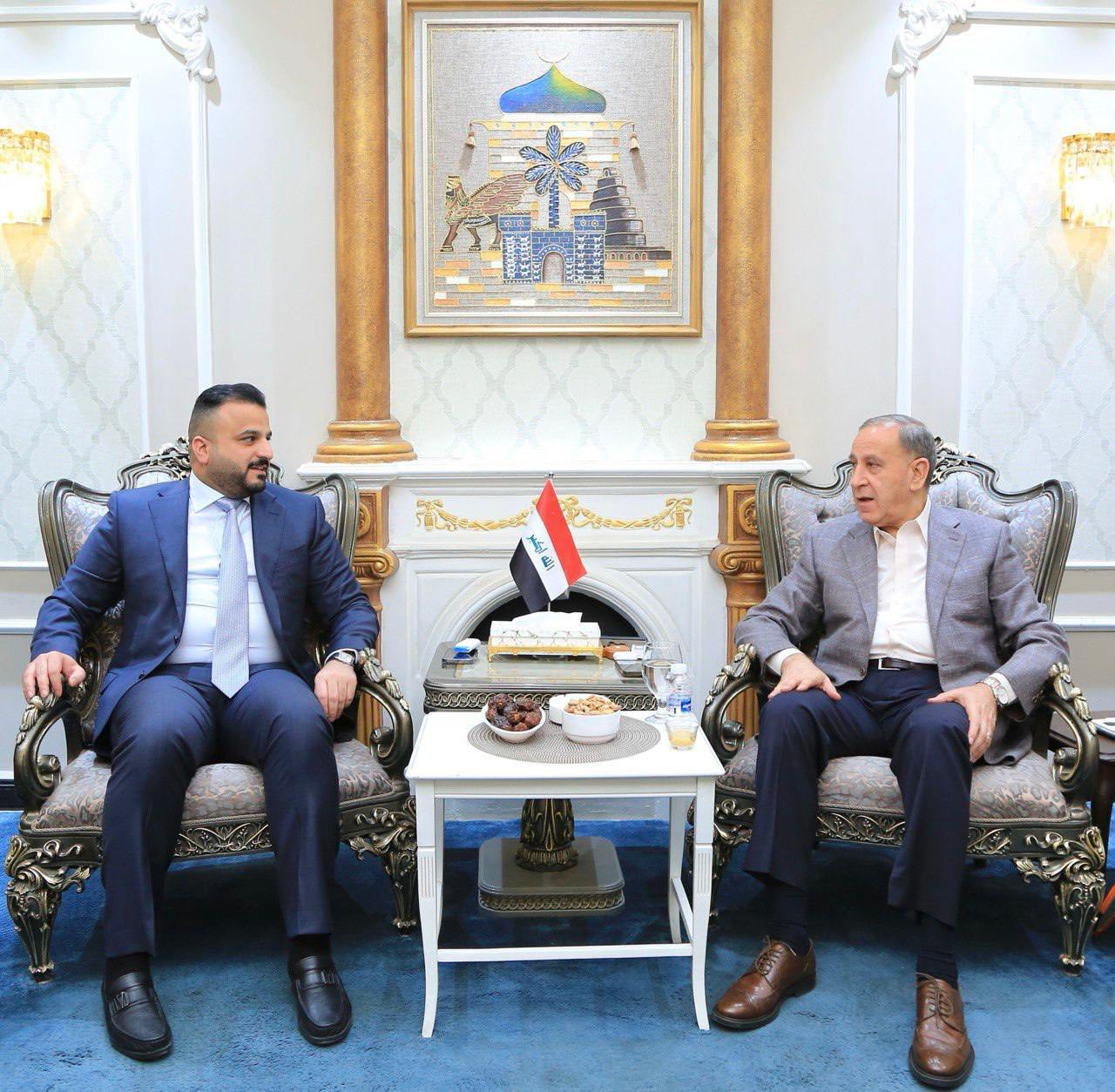

وفي 31 تشرين الأول 2025، استخدمت بعض الصفحات على منصات التواصل الاجتماعي التزييف والتضليل، ومن المرجح أن بعضاً منها لجأ إلى تقنيات الذكاء الاصطناعي للتأثير على الرأي العام. حيث تم تداول صورة مزيفة نُسبت إلى المرشح عن تحالف البديل سجاد سالم، زُعم أنها التُقطت خلال لقاء رسمي مع شخصية إسرائيلية.

إحدى الصفحات التي نشرت الصورة، كانت تحمل اسم “أبناء الحشد الشعبي” وجمع منشورها وحده أكثر من ألف تعليق و1800 تفاعل وعشرات المشاركات حتى تاريخ 27 تشرين الثاني 2025. وقد استغلت الصفحة اسم الحشد الشعبي لنشر المحتوى ضد النائب سجاد سالم، المعروف بمطالبه بحصر السلاح بيد الدولة وانتقاداته لبعض القوى المسلحة، في محاولة للإيحاء بعلاقاته بجهات أجنبية والتأثير على مصداقيته.

وأدّى انتشار المنشور إلى تصاعد الخلافات بين مؤيدي سالم ومعارضيه، خلاف ظهر من خلال منشورات شاركت الادعاء وتعليقات على الصورة، على الرغم من أن الصورة الأصلية وبعد التحقق منها تبين أنها تعود بالأصل إلى تاريخ 1 أيار 2025، وهي للقاء جمع بين النائب سجاد سالم والنائب خالد العبيدي، لبحث مستجدات المشهد السياسي والاستعدادات للانتخابات.

السخرية المصطنعة.. مقاطع مُولَّدة لاستهداف المرشحين

لم يقتصر استهداف المرشحين في الفضاء الرقمي باستخدام الذكاء الاصطناعي على التشويه السياسي أو الشخصي، بل لجأت بعض الصفحات أيضاً إلى التقليل من شأن بعض المرشحين والسخرية منهم، في محاولة للتأثير على صورتهم أمام الجمهور وتشويه حضورهم الانتخابي.

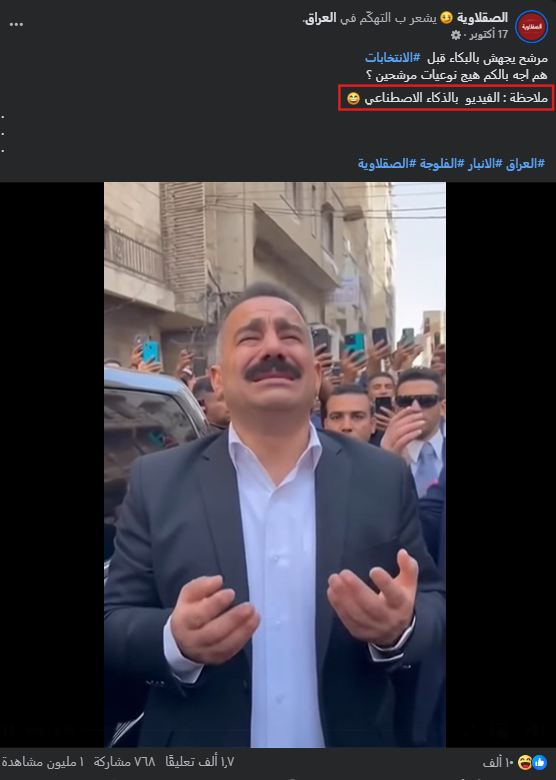

حيث نشرت حسابات على منصة تيكتوك، مقطع فيديو يظهر أحد المرشحين يجهش بالبكاء ويتوجه بالدعاء من أجل الفوز في الانتخابات العراقية، وحصد الادعاء أكثر من 49 ألف من التفاعلات حتى تاريخ 27 تشرين الثاني 2025 ولاقى انتشاراً واسعاً على منصات التواصل الاجتماعي.

@v56_a #المرشحين #انتخابات #البرلمان #العراق #مرشح ♬ الصوت الأصلي – العراقي

وبالتحقق من صحة الفيديو المتداول، تبيّن أن النسخة الأصلية الخالية من أي نص مضمّن، نُشرت لأول مرة في 16 تشرين الأول في حساب يحمل اسم “الصقلاوية” على منصة فيسبوك. وقد أوضحت الصفحة في وصف المقطع أنه مُنتَج باستخدام الذكاء الاصطناعي.

لكن الصفحات الأخرى التي أعادت نشر الفيديو تجاهلت هذا التوضيح تماماً، ولم تشر إلى أنه مُولّد بالذكاء الاصطناعي، ما أسهم في تضليل الجمهور وزيادة انتشار الادعاء المزوّر.

ولم يقتصر حساب “الصقلاوية” على نشر ذلك الفيديو فحسب، بل أظهر البحث داخل الحساب وجود مقاطع أخرى مُولّدة بالذكاء الاصطناعي تستهدف عدداً من المرشحين، وبعض تلك المقاطع نُشر من دون أي تنويه يشير إلى أنها مولّدة بالذكاء الاصطناعي.

وفي 5 تشرين الأول 2025، نشر أحد الحسابات على منصة فيسبوك، مقطع فيديو بمزاعم أنه يُظهر دعاية انتخابية لنور زهير، المتهم فيما يعرف بـ“سرقة القرن”، موضوعة وسط أحد الشوارع للترويج لترشحه ضمن قائمة ائتلاف “الإعمار والتنمية” التي يرأسها رئيس الوزراء العراقي الحالي، محمد شياع السوداني. وحصد الفيديو أكثر من 189 ألف مشاهدة على حساب واحد فقط حتى تاريخ 27 تشرين الثاني 2025.

وعلى الرغم من أن الفيديو مولد بالذكاء الاصطناعي من خلال ملاحظة كلمة “Veo” في أسفله، وهي العلامة المائية لنموذج الذكاء الاصطناعي (DeepMind) التابع لشركة غوغل، فإنه استند أساساً إلى دعاية مرشّح آخر من القائمة نفسها يحمل اسم “سامر جيرمني” من محافظة واسط، وجرى استبدال الاسم والصورة والإبقاء على رقم القائمة وتسلسل المرشح، ليظهر على شكل مقطع لا تتجاوز مدته ثمان ثوان، وهي المدة التي تتيحها بعض منصات توليد الفيديو المجانية — وحقق انتشاراً واسعاً. كما جرى اقتطاع لقطات ثابتة من المقطع وإعادة تداولها عبر حسابات متعددة على منصات التواصل الاجتماعي، مما أسهم في توسيع نطاق نشر المحتوى المضلل.

انتهاء فترة الانتخابات لم تنه توليد مقاطع الذكاء الاصطناعي

لم تتوقف العديد من الصفحات عند توليد مقاطع فيديو بالذكاء الاصطناعي خلال فترة الدعاية الانتخابية واستهداف المرشحين، بل واصلت ذلك حتى بعد إعلان النتائج وخسارة بعض المرشحين، حيث تحوّل نشاط بعض الحسابات إلى أنشطة ممنهجة تتضمن السخرية والتنمر على المرشحين الخاسرين.

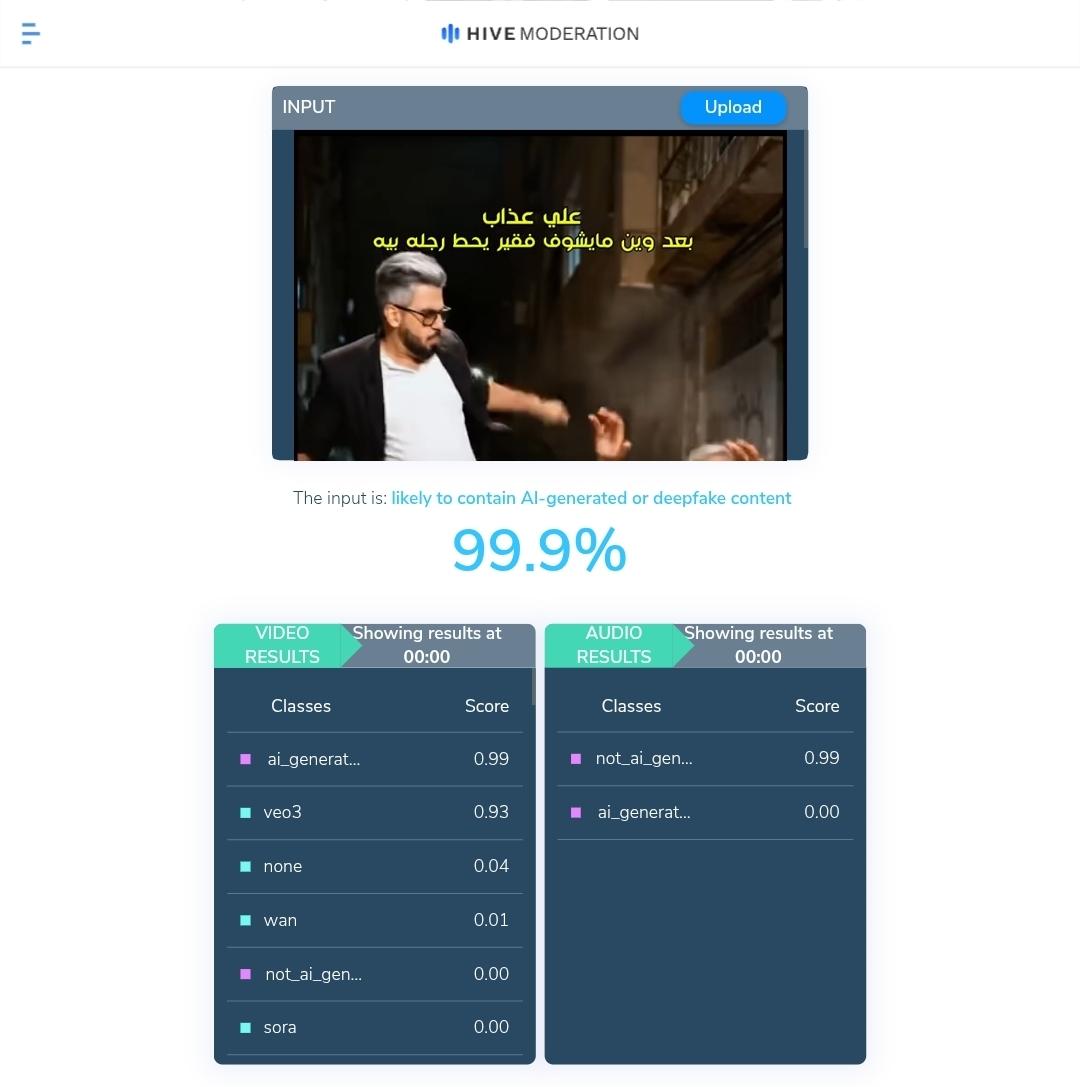

ففي 22 تشرين الثاني 2025، نشرت صفحات على مواقع التواصل الاجتماعي، ولا سيما على منصة فيسبوك، مقطع فيديو يدعي أنه يعود للمرشح أمين عام تيار “من الواقع الوطني” والناشط في المجال الإنساني، الإعلامي علي عذاب، بمزاعم أن الفيديو يوثق رد فعله “العنيف” تجاه المسنين بسبب خسارته في الانتخابات. وبتفقد حساب المرشح، لم نجد أي رد على الفيديو، ولكن وجدنا أنه نشر في 12 تشرين الثاني 2025 في صفحته الرسمية على انستغرام، رسالة شكر لمن صوّت له، وأكد خلاله التزامه بمبادئه.

وبعد التحقق وفحص الفيديو بواسطة أداة (hive moderation) المختصة بفحص المحتوى المولد بالذكاء الاصطناعي، أظهرت نتيجة الفحص أنَّ الفيديو مولد بنسبة 99.9% بالذكاء الاصطناعي، كما لم نجد أي أدلة تؤكد حدوث واقعة مشابهة.

ولجأت حسابات أخرى، إلى إنتاج مقاطع مضللة تزعم ارتفاع نسب المشاركة أو تقدّم قائمة على أخرى، أو تفوّق مرشح على منافسيه، إضافةً إلى توليد بعض المقاطع بهدف الترويج لمقاطعة الانتخابات وتوصيفها بأنها “موسم للكذب والضحك على الناخبين”، في محاولة للتأثير على المعلومات المتداولة المتعلقة بالعملية الانتخابية.

وفي 11 تشرين الثاني 2025، جرى تداول مقطع فيديو مُولد بالذكاء الاصطناعي تظهر على جانبه علامة “Veo”، وهي علامة أداة لإنتاج فيديوهات مولدة بالذكاء الاصطناعي. وتظهر في الفيديو مراسلة تلفزيونية تقف أمام تجمع يُنسب لرئيس “ائتلاف دولة القانون” نوري المالكي، وتقول: “إقبال واسع في مراكز الانتخابات في بغداد، ودولة القانون تفوز بأغلب الأصوات”.

إلا أنّ نتائج التصويت في بغداد أظهرت أن المركز الأول كان من نصيب “ائتلاف الإعمار والتنمية” التابع لرئيس الوزراء محمد شياع السوداني، فيما جاء “ائتلاف دولة القانون” بزعامة المالكي في المرتبة الثالثة داخل العاصمة.

وعلى الرغم من جهود بعض المنصات المعنية لكشف الأخبار المضللة والتحذير المستمر من استخدام التضليل، خصوصاً خلال أيام الانتخابات، فإن سهولة الوصول إلى تقنيات الذكاء الاصطناعي ساعدت على انتشار هذه المقاطع.

وبحسب الباحث في مجال الأمن الرقمي، محمد عبد الله، فإن الانتخابات البرلمانية العراقية لعام 2025 شهدت شكلاً جديداً من التلاعب والتضليل عبر استخدام تقنيات الذكاء الاصطناعي في توليد فيديوهات تستهدف المرشحين وتؤثر في توجهات الناخبين.

وأوضح عبد الله، أن ازدياد هذا النوع من المحتوى ليس أمراً مستغرباً في سياق الانتخابات حول العالم، إلا أن اللافت في هذه الدورة الانتخابية هو توفر أدوات الذكاء الاصطناعي مجاناً وبسهولة للجميع، وبجودة تجعل من الصعب على مستخدمي منصات التواصل الاجتماعي التمييز بين المحتوى الحقيقي والمزور. وأضاف، أن هذا التطور يمثل مؤشراً خطيراً لاستخدام أداة تقنية متقدمة كسلاح في اتجاهات غير مشروعة.

ومع استمرار تطور هذه الأدوات، يظل التحدي الأكبر أمام الجمهور والمنصات الإعلامية هو التمييز بين الحقيقة والمحتوى المضلل، ما يسلط الضوء على أهمية تعزيز الوعي الرقمي وتطوير آليات التحقق خلال فترات الانتخابات أو كلما ما يؤثر على الرأي العام رقمياً وتكون نتائجه واقعية.